شاید شما هم بارها در میان انبوهی از ویدیوهای آموزشی و مقالات پراکنده در دنیای اینترنت گم شدهاید و هنوز نمیدانید دقیقاً از کجا باید یادگیری علم داده را شروع کنید. بسیاری از علاقهمندان با شور و اشتیاق وارد این مسیر میشوند اما به دلیل نبود یک نقشه راه شفاف، در نیمه راه خسته شده و یادگیری را رها میکنند.

در این راهنما، ما تمام حاشیهها را کنار میزنیم و به صورت مستقیم و عملی، شما را از یک فرد مبتدی به یک متخصص توانمند در تحلیل دادهها تبدیل میکنیم تا بتوانید به پرسشهای واقعی کسبوکارها پاسخ دهید.

ویدیو آموزشی ۱:

۱. آمادهسازی محیط کار و ابزارهای اولیه

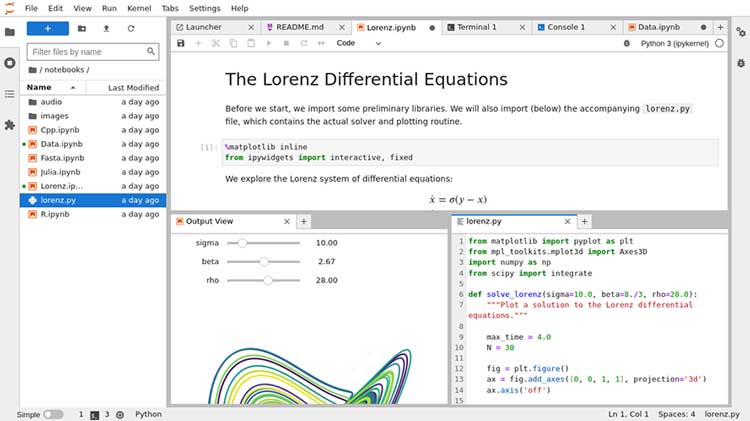

نخستین گام برای ورود به دنیای علم داده (دیتا ساینس)، ایجاد یک کارگاه مجهز در سیستم شخصی شماست که بتوانید کدهای خود را بدون دردسر در آن اجرا کنید. پیشنهاد ما نصب توزیع آناکوندا (Anaconda) است که به طور خودکار پایتون و اکثر کتابخانههای مورد نیاز را برای شما فراهم میکند.

پس از نصب، بهتر است از محیط ویاس کد (VS Code) یا ژوپیتر نوتبوک (Jupyter Notebook) استفاده کنید تا بتوانید قطعات کد را به صورت جداگانه اجرا کرده و خروجیها را بلافاصله مشاهده نمایید. این کار به شما کمک میکند تا خطاهای خود را در لحظه شناسایی کرده و سرعت یادگیریتان را چندین برابر افزایش دهید.

داشتن یک محیط مدیریت شده به شما این امکان را میدهد که پروژههای مختلف را از یکدیگر جدا نگه دارید و نگران تداخل نسخههای مختلف نرمافزاری نباشید. علم داده در سال ۲۰۲۶ بیش از هر زمان دیگری به سرعت و دقت وابسته است و استفاده از ابزارهای استاندارد، اولین نشانه حرفهای بودن شماست.

پس از اینکه محیط خود را آماده کردید، یک بار کد ساده چاپ متن را اجرا کنید تا از صحت نصب پایتون مطمئن شوید. این مرحله شاید ساده به نظر برسد، اما پیریزی درست ساختمان دانش شما از همینجا آغاز میشود و نباید با عجله از آن عبور کنید.

۲. تسلط بر الفبای پایتون با نگاه دادهمحور

برای موفقیت در علم داده، نیازی نیست که یک توسعهدهنده نرمافزار حرفهای باشید، اما باید بر بخشهایی از زبان پایتون که با دادهها سر و کار دارند، مسلط شوید. مفاهیمی مانند متغیرها، لیستها، دیکشنریها و حلقههای تکرار، ابزارهای اصلی شما برای دستکاری دادههای خام هستند.

شما باید بتوانید دادهها را از منابع مختلف بخوانید، آنها را فیلتر کنید و تغییرات لازم را روی آنها اعمال نمایید. یادگیری توابع (Functions) نیز به شما کمک میکند تا کدهای خود را تمیزتر بنویسید و از تکرار مکرر دستورات مشابه در طول پروژه جلوگیری کنید. علاوه بر توابع، باید با ساختارهای شرطی (Conditionals) آشنا شوید که به برنامههای شما قدرت تصمیمگیری میدهند. برای مثال، میتوانید کدی بنویسید که اگر مقدار یک داده از حد خاصی فراتر رفت، آن را به عنوان یک هشدار علامتگذاری کند.

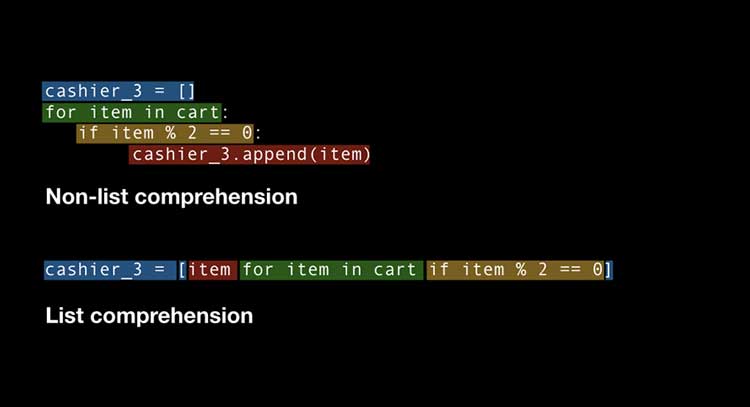

همچنین، درک مفهوم درک لیست (List Comprehensions) در پایتون به شما اجازه میدهد عملیاتهای پیچیده را در یک خط کد کوتاه و خوانا انجام دهید. این ویژگی یکی از دلایل محبوبیت پایتون در میان دانشمندان داده است، زیرا کدنویسی را سریعتر و لذتبخشتر میکند.

سعی کنید با تمرینهای مداوم، این مفاهیم را در ذهن خود تثبیت کنید تا در مراحل بعدی که با حجم عظیمی از دادهها روبرو میشوید، به راحتی بتوانید آنها را مدیریت کنید. تسلط بر این جزئیات کوچک است که تفاوت میان یک کدنویس معمولی و یک متخصص علم داده را رقم میزند.

تمرکز خود را روی یادگیری ساختارهای دادهای بگذارید که در تحلیلهای آماری بیشترین کاربرد را دارند و سعی کنید با مثالهای واقعی تمرین کنید. برای نمونه، سعی کنید لیستی از نمرات یا قیمت کالاها را ایجاد کرده و میانگین آنها را با استفاده از حلقهها محاسبه کنید.

این تمرینهای کوچک ذهن شما را برای مواجهه با مجموعهدادههای (Datasets) بزرگ در مراحل بعدی آماده میکند. پایتون به دلیل سادگی و شباهت زیاد به زبان انگلیسی، به شما اجازه میدهد که بیشتر روی حل مسئله تمرکز کنید تا درگیر پیچیدگیهای نحوی زبان برنامهنویسی شوید.

۳. کار با کتابخانههای عددی و ساختاردهی دادهها

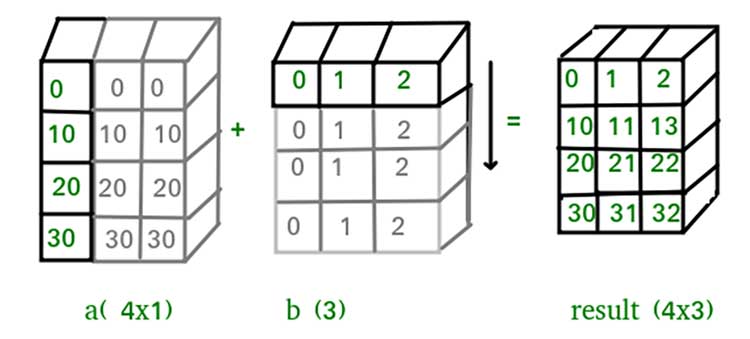

پس از یادگیری مبانی، نوبت به آشنایی با غولهای دنیای علم داده یعنی نامپای (NumPy) و پانداز (Pandas) میرسد که قلب تپنده هر پروژه تحلیلی هستند. نامپای به شما اجازه میدهد محاسبات ریاضی سنگین را روی آرایههای چندبعدی با سرعتی باورنکردنی انجام دهید، چیزی که لیستهای معمولی پایتون از عهده آن برنمیآیند.

در واقع، اکثر ابزارهای پیشرفتهای که در آینده با آنها کار خواهید کرد، بر پایه نامپای بنا شدهاند. یادگیری نحوه ایجاد آرایهها، ضرب ماتریسها و استفاده از توابع ریاضی این کتابخانه، مهارت محاسباتی شما را به سطح جدیدی ارتقا میدهد.

اما ستاره واقعی این مرحله، کتابخانه پانداز است که دادههای شما را در قالب جداولی هوشمند به نام دیتافریم (DataFrame) سازماندهی میکند. با پانداز میتوانید به سادگی فایلهای اکسل یا سیاسوی (CSV) را فراخوانی کرده، ستونهای اضافی را حذف کنید و دادههای ناقص را بازسازی نمایید.

توانایی فیلتر کردن دادهها بر اساس شرایط خاص و گروهبندی آنها برای گرفتن آمارهای توصیفی، از مهمترین مهارتهایی است که در این بخش کسب خواهید کرد. با استفاده از عملیات گروهبندی (Grouping)، میتوانید دادههای حجیم را بر اساس دستهبندیهای مختلف خلاصه کرده و میانگین یا مجموع مقادیر را برای هر دسته به دست آورید.

همچنین، یادگیری نحوه ادغام (Merging) و چسباندن (Joining) چندین جدول به یکدیگر، مهارتی است که در پروژههای واقعی بسیار به کارتان میآید؛ چرا که دادهها معمولاً در فایلهای جداگانه ذخیره شدهاند. مدیریت دادههای زمانی (Time Series) نیز یکی دیگر از قابلیتهای بینظیر پانداز است که به شما اجازه میدهد تغییرات متغیرها را در طول روزها، ماهها و سالها به دقت تحلیل کنید.

اکثر زمان یک دانشمند داده صرف تمیزکاری دادهها میشود و پانداز بهترین رفیق شما در این مسیر پرچالش خواهد بود. با تسلط بر این ابزار، شما قادر خواهید بود حتی از آشفتهترین دادهها، اطلاعاتی ارزشمند و ساختاریافته استخراج کنید که پایه و اساس هرگونه تصمیمگیری هوشمندانه در سازمانها است.

۴. هنر نمایش دادهها و مصورسازی هوشمند

اعداد و جداول به تنهایی نمیتوانند داستان پنهان در دل دادهها را برای مدیران یا مشتریان بازگو کنند، اینجاست که قدرت مصورسازی (Data Visualization) وارد عمل میشود. کتابخانه ماتپلاتلیب (Matplotlib) به عنوان قدیمیترین و منعطفترین ابزار، به شما اجازه میدهد انواع نمودارهای خطی، ستونی و پراکندگی را با جزئیات کامل رسم کنید.

یادگیری نحوه تنظیم محورها، افزودن راهنمای نمودار و تغییر رنگها، به شما کمک میکند تا گزارشهایی دقیق و حرفهای تهیه کنید. انتخاب نوع نمودار متناسب با نوع دادهها، هنری است که باید به مرور زمان بیاموزید؛ مثلاً برای نمایش روند تغییرات در طول زمان، نمودار خطی بهترین گزینه است، در حالی که برای مقایسه دستههای مختلف، نمودار ستونی کارایی بیشتری دارد.

همچنین، یادگیری نحوه نمایش چندین نمودار در یک صفحه (Subplots) به شما اجازه میدهد تا جنبههای مختلف یک مسئله را به طور همزمان با هم مقایسه کنید. مصورسازی نه تنها برای ارائه نهایی، بلکه برای درک بهتر خودتان از توزیع دادهها و شناسایی الگوهای غیرمنتظره نیز بسیار حیاتی است.

در واقع، بسیاری از فرضیات اولیه شما ممکن است پس از رسم یک نمودار ساده، کاملاً تغییر کنند یا تایید شوند. به همین دلیل، توصیه میشود همیشه قبل از هرگونه تحلیل آماری پیچیده، ابتدا دادههای خود را با استفاده از ابزارهای بصری کاوش کنید تا دید بهتری نسبت به ماهیت آنها پیدا کنید.

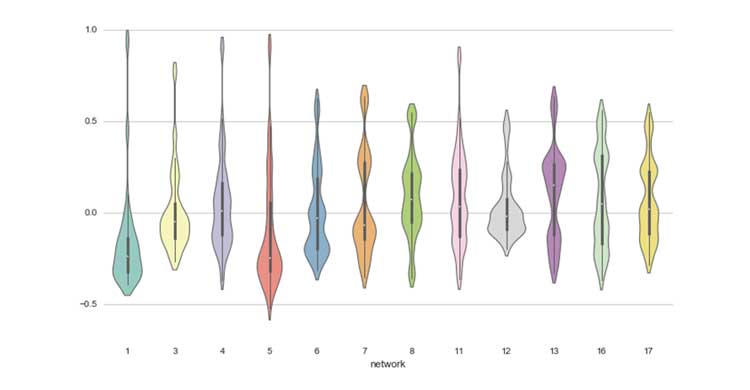

برای ایجاد نمودارهای زیباتر و تحلیلهای آماری پیشرفتهتر، باید به سراغ کتابخانه سیبورن (Seaborn) بروید که بر پایه ماتپلاتلیب ساخته شده است. سیبورن با دستوراتی سادهتر، نمودارهای پیچیدهای مانند نقشههای حرارتی (Heatmaps) و نمودارهای جعبهای (Box plots) را رسم میکند که برای شناسایی دادههای پرت (Outliers) عالی هستند.

در سال ۲۰۲۶، توانایی تولید نمودارهای تعاملی و جذاب یکی از شاخصهای برتری در بازار کار است. سعی کنید همیشه قبل از هرگونه مدلسازی، دادههای خود را به تصویر بکشید تا الگوهای پنهان و رفتارهای غیرعادی آنها را با چشم مشاهده کنید.

۵. درک مفاهیم پایه آمار و احتمال برای تحلیلهای دقیق

علم داده بدون دانش آمار، چیزی جز کدنویسی کورکورانه نیست و برای اینکه بتوانید نتایج درستی از تحلیلهای خود بگیرید، باید با مفاهیم پایهای ریاضی آشنا شوید. مفاهیمی مانند میانگین، میانه، انحراف معیار و توزیع نرمال به شما میگویند که دادههایتان در چه وضعیتی هستند و چقدر میتوانید به آنها اعتماد کنید.

شما باید بدانید که چگونه فرضیههای آماری را تعریف کرده و با استفاده از آزمونهای مختلف، معنادار بودن نتایج به دست آمده را بررسی نمایید. این دانش به شما کمک میکند تا تفاوت میان یک تغییر تصادفی و یک روند واقعی را به خوبی درک کنید.

احتمالات نیز در پیشبینی آینده نقش کلیدی ایفا میکنند و به شما اجازه میدهند شانس وقوع یک رویداد خاص را محاسبه کنید. برای مثال، در تحلیل رفتار مشتری، دانستن احتمال خرید مجدد یک فرد بر اساس خریدهای قبلی، میتواند استراتژیهای فروش یک شرکت را دگرگون کند.

پایتون کتابخانههایی مانند سایپای (SciPy) را در اختیار شما قرار میدهد تا این محاسبات پیچیده را به سادگی انجام دهید. به یاد داشته باشید که هدف ما در این مرحله تبدیل شدن به یک ریاضیدان نیست، بلکه درک کاربردی این مفاهیم برای اتخاذ تصمیمات مبتنی بر دادههای واقعی است که از بروز خطاهای فاحش جلوگیری میکند.

۶. ورود به دنیای یادگیری ماشین و پیشبینیهای هوشمند

حالا که دادهها را تمیز کرده و آنها را به تصویر کشیدهاید، نوبت به هیجانانگیزترین بخش یعنی یادگیری ماشین (Machine Learning) میرسد. کتابخانه سایکیتلرن (Scikit-Learn) استاندارد طلایی پایتون برای اجرای الگوریتمهای هوشمند است که به شما اجازه میدهد مدلهایی برای طبقهبندی یا پیشبینی اعداد (رگرسیون) بسازید.

شما با استفاده از این ابزار میتوانید دادههای خود را به دو بخش آموزش و آزمایش تقسیم کرده و به رایانه یاد بدهید که الگوهای موجود در دادههای گذشته را کشف کند. این مرحله جایی است که شما از یک تحلیلگر ساده به یک دانشمند داده واقعی تبدیل میشوید.

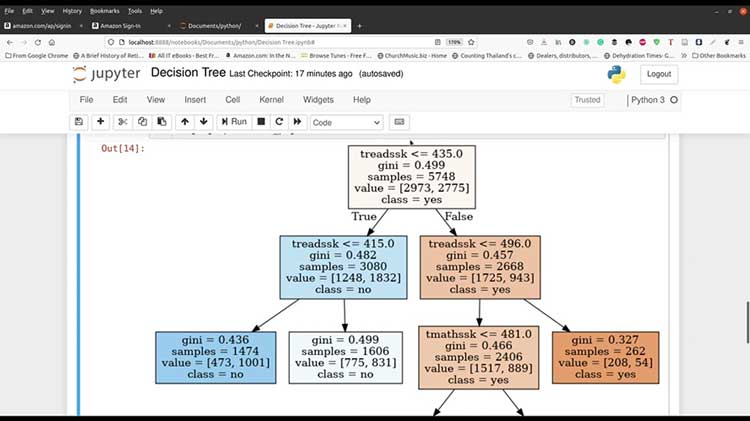

الگوریتمهای متنوعی مانند درخت تصمیم (Decision Tree)، جنگل تصادفی (Random Forest) و خوشهبندی (Clustering) در دسترس شما هستند که هر کدام برای نوع خاصی از مسائل کاربرد دارند. یادگیری نحوه ارزیابی مدلها با استفاده از معیارهایی مانند دقت (Accuracy) و خطا (Error) به شما نشان میدهد که پیشبینیهایتان چقدر به واقعیت نزدیک است.

علاوه بر این، باید با مفاهیمی مانند ماتریس درهمریختگی (Confusion Matrix) آشنا شوید که به شما میگوید مدل شما در چه مواردی دچار اشتباه شده و چه نوع خطاهایی را بیشتر مرتکب میشود. درک تفاوت میان رگرسیون خطی (Linear Regression) برای پیشبینی اعداد پیوسته و رگرسیون لجستیک (Logistic Regression) برای دستهبندی دوتایی، از اولین گامهای تخصصی در این حوزه است. در سال ۲۰۲۶، یادگیری ماشین دیگر یک تکنولوژی لوکس نیست، بلکه ابزاری ضروری برای رقابت در هر صنعتی محسوب میشود که میتواند هزینهها را کاهش و بهرهوری را افزایش دهد.

سعی کنید با پروژههای ساده مانند پیشبینی قیمت مسکن یا تشخیص ایمیلهای مزاحم شروع کنید تا به مرور در تنظیم پارامترهای مدلهای پیچیده مهارت پیدا کنید. هرچه بیشتر با مدلهای مختلف کار کنید، شهود شما در انتخاب الگوریتم مناسب برای هر مسئله تقویت خواهد شد و میتوانید راهکارهای خلاقانهتری برای چالشهای پیچیده ارائه دهید.

۷. اجرای پروژههای واقعی با دادههای زنده و گوگل ترندز

برای اینکه دانش خود را به چالش بکشید و تجربه عملی کسب کنید، باید به سراغ دادههای واقعی در دنیای اطراف خود بروید. یکی از بهترین منابع برای این کار، استفاده از دادههای گوگل ترندز (Google Trends) است که به شما نشان میدهد مردم در زمانهای مختلف به دنبال چه موضوعاتی بودهاند.

با استفاده از کتابخانههای پایتون میتوانید این دادهها را استخراج کرده و تحلیل کنید که مثلاً تقاضا برای یک محصول خاص در فصلهای مختلف چگونه تغییر کرده است. این نوع تحلیلهای زمانی به شما دید عمیقی درباره رفتار بازار و علایق کاربران میدهد که برای هر کسبوکاری ارزشمند است.

برای مثال، میتوانید بررسی کنید که کلمه کلیدی «خرید آنلاین» در زمانهای خاصی از سال چه تغییری میکند و این دادهها را با نرخ تورم یا قیمت ارز در پایتون همبسته (Correlate) کنید. چنین تحلیلهایی به شما کمک میکند تا نه تنها گذشته را درک کنید، بلکه بتوانید روندهای آتی را با دقت بیشتری پیشبینی کنید.

در سال ۲۰۲۶، ابزارهای پایتون به قدری پیشرفته شدهاند که شما میتوانید با چند خط کد، دادههای عظیم گوگل را به نمودارهای معنادار تبدیل کنید. استفاده از این دادهها در پروژههای شخصی، نشاندهنده هوشمندی شما در انتخاب منابع اطلاعاتی است و پورتفولیوی شما را از سایر رقبا متمایز میکند. همیشه به دنبال یافتن روابط غیرمنتظره میان مجموعهدادههای مختلف باشید تا بتوانید ارزش افزودهای واقعی برای کسبوکارها خلق کنید.

انجام پروژههای انتهای دوره به شما کمک میکند تا تمام تکههای پازلی که تا اینجا یاد گرفتهاید را در کنار هم قرار دهید. سعی کنید یک مسئله واقعی را تعریف کنید، دادههای مربوط به آن را از اینترنت جمعآوری (Data Scraping) کنید، مراحل تمیزکاری و تحلیل را روی آنها اجرا نمایید و در نهایت یک مدل پیشبینی بسازید.

این فرآیند کامل، اعتماد به نفس شما را برای پذیرش پروژههای تجاری افزایش میدهد و به شما میآموزد که چگونه با چالشهای پیشبینی نشده در دنیای واقعی روبرو شوید. یادتان باشد که در علم داده، هیچ چیز جایگزین تجربه کار با دادههای کثیف و نامنظم واقعی نمیشود.

۸. ساخت پورتفولیو و آمادگی برای ورود به بازار کار

آخرین گام در این مسیر طولانی، نمایش توانمندیهایتان به دنیا و جذب فرصتهای شغلی مناسب است. شما باید بهترین پروژههای خود را در بسترهایی مانند گیتهاب (GitHub) منتشر کنید و کدهای خود را به شکلی تمیز و مستند در اختیار دیگران قرار دهید.

داشتن یک پورتفولیو (نمونه کار) قوی که در آن مراحل حل مسئله را به وضوح توضیح داده باشید، بسیار موثرتر از داشتن چندین مدرک کاغذی است. در سال ۲۰۲۶، کارفرمایان به دنبال کسانی هستند که بتوانند به صورت عملی نشان دهند چگونه از دادهها برای خلق ارزش استفاده میکنند.

علاوه بر گیتهاب، حضور فعال در شبکههای حرفهای و اشتراکگذاری تحلیلهایتان میتواند درهای زیادی را به روی شما باز کند. سعی کنید در مسابقات تحلیل داده شرکت کنید یا در پروژههای متنباز (Open Source) مشارکت داشته باشید تا شبکه ارتباطی خود را گسترش دهید.

نوشتن مقالات کوتاه درباره یافتههایتان در پروژههای شخصی نیز به برندسازی شخصی شما کمک شایانی میکند. علم داده مسیری است که در آن یادگیری هرگز متوقف نمیشود، بنابراین همیشه بهروز بمانید و از تجربیات دیگران استفاده کنید. آیا شما هم پروژهای در ذهن دارید که بخواهید با پایتون آن را شروع کنید؟ حتماً در بخش نظرات ایده خود را با ما در میان بگذارید تا درباره آن گفتگو کنیم.

ویدیو آموزشی ۲:

خطاهای رایج و راه جلوگیری از آنها

یکی از بزرگترین اشتباهات مبتدیان در علم داده، نادیده گرفتن مرحله تمیزکاری دادهها و عجله برای اجرای مدلهای پیچیده است. دادههای خام معمولاً دارای مقادیر گم شده، فرمتهای اشتباه و اطلاعات تکراری هستند که اگر به درستی اصلاح نشوند، خروجی مدل شما کاملاً بیارزش خواهد بود.

همیشه زمان کافی برای بررسی کیفیت دادهها اختصاص دهید و از توابعی مانند حذف مقادیر پوچ یا جایگزینی آنها با میانگین استفاده کنید. به یاد داشته باشید که یک مدل ساده با دادههای باکیفیت، همیشه بهتر از یک مدل پیشرفته با دادههای آلوده عمل میکند.

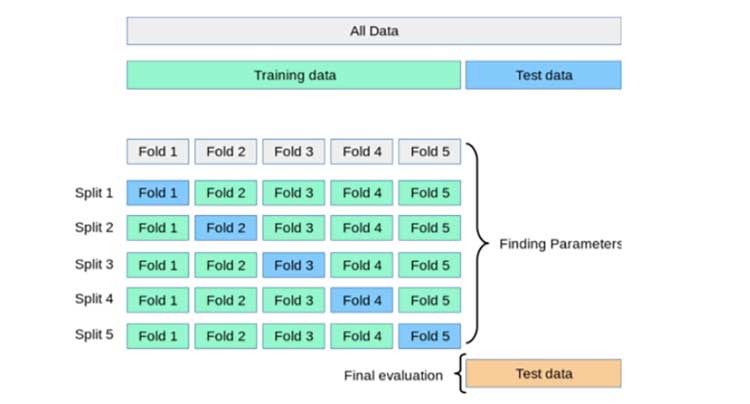

خطای رایج دیگر، بیشبرازش (Overfitting) است که در آن مدل شما الگوهای تصادفی و نویزهای دادههای آموزشی را یاد میگیرد و در نتیجه روی دادههای جدید عملکرد بسیار ضعیفی دارد. برای جلوگیری از این مشکل، حتماً دادههای خود را به دو بخش آموزش و آزمایش تقسیم کنید و از روشهای اعتبارسنجی متقاطع (Cross-Validation) استفاده نمایید.

همچنین، سعی کنید از مدلهای بیش از حد پیچیده برای مسائل ساده استفاده نکنید و همیشه سادگی را در اولویت قرار دهید. درک این نکته که مدل شما نباید دادهها را حفظ کند بلکه باید آنها را بفهمد، کلید موفقیت در یادگیری ماشین است.

منابع پیشنهادی برای ادامه یادگیری

کتابهایی با عناوین «پایتون برای تحلیل دادهها» نوشته وس مککینی (خالق پانداز) و «یادگیری ماشین با سایکیتلرن و تنسورفلو» منابعی کلاسیک و در عین حال کاربردی هستند که مطالعه آنها دید بسیار خوبی به شما میدهد. علاوه بر این، مطالعه کتاب «آمار کاربردی برای دانشمندان داده» میتواند پایه ریاضی شما را تقویت کند و به شما بیاموزد که چگونه از ابزارهای آماری در محیط پایتون استفاده کنید.

همچنین، وبسایتهایی مانند مدیوم (Medium) و بخش تخصصی «توس به سمت علم داده» (Towards Data Science) مقالات بسیار بهروزی درباره تکنیکهای جدید سال ۲۰۲۶ منتشر میکنند که خواندن روزانه آنها شما را در لبه دانش نگه میدارد. شرکت در تالارهای گفتگو مانند استک اورفلو (Stack Overflow) نیز برای حل مشکلات کدنویسی و یادگیری از تجربیات دیگران بسیار ضروری است.

هرچه منابع مطالعاتی خود را متنوعتر کنید، دید جامعتری نسبت به ابزارهای مختلف پیدا خواهید کرد و در انتخاب راهکار مناسب برای مسائل مختلف، دستتان بازتر خواهد بود. یادگیری علم داده یک ماراتن است، نه یک دو سرعت؛ پس با برنامهریزی و استفاده از منابع معتبر، مسیر خود را هموار کنید.

همچنین دنبال کردن وبلاگهای تخصصی و پادکستهای مرتبط با علم داده به شما کمک میکند تا از آخرین تغییرات تکنولوژی در سال ۲۰۲۶ باخبر بمانید. فراموش نکنید که بهترین منبع، تمرین مداوم و حل مسائل واقعی است؛ پس از خواندن هر فصل، سعی کنید آن را روی یک مجموعهداده جدید پیادهسازی کنید تا دانش در ذهن شما تثبیت شود.

اقدامات پایانی برای شروع طوفانی

حالا که با نقشه راه کامل علم داده آشنا شدید، نوبت به اقدام عملی میرسد؛ همین امروز پایتون را نصب کنید و اولین خط کد خود را بنویسید. یادگیری این مهارت شاید در ابتدا کمی دشوار به نظر برسد، اما با استمرار و تمرین روزانه، به زودی طعم شیرین کشف حقایق از دل اعداد را خواهید چشید. ما در این مسیر همراه شما هستیم و مشتاقیم تا نتایج تلاشهای شما را ببینیم. اگر این مقاله برایتان مفید بود، آن را با دوستان علاقهمند خود به اشتراک بگذارید تا آنها هم مسیر درست را پیدا کنند.

آیا سوالی دارید که در این مقاله به آن پاسخ داده نشده است؟ یا در مرحله خاصی از نصب و اجرا دچار مشکل شدهاید؟ حتماً در بخش نظرات پایین همین صفحه سوالات و تجربیات خود را بنویسید. ما به تکتک نظرات شما پاسخ میدهیم و سعی میکنیم در کنار هم مشکلات را حل کنیم. اشتراکگذاری تجربیات شما میتواند به دیگران هم کمک کند تا از اشتباهات مشابه دوری کنند و سریعتر به هدفشان برسند. منتظر شنیدن داستان موفقیت شما در دنیای دیتا ساینس هستیم!